Yapay zekanın beşerler üzerinde denetim sağlaması yahut ziyan verme ihtimalinin büsbütün dışlanamayacağını tabir eden Bilgisayar Mühendisliği Kısmı Lideri Prof. Dr. Burhan Pektaş, “Bu tıp distopik senaryoların büsbütün imkansız olduğunu söylemek sıkıntı. Lakin, mevcut yapay zeka (YZ) sistemleri, evvelce belirlenmiş amaçlara bağlı olarak çalışır ve kendi başına maksat oluşturamaz.” dedi.

Yapay zekanın süratle geliştiği günümüzde, bu teknolojinin potansiyel tehditlerini önlemek için küresel iş birliği ve etik standartların daha süratli geliştirilmesi gerektiğini lisana getiren Prof. Dr. Burhan Pektaş, “Büyük kısmı varsayımsal olsa da YZ’nin süratli gelişimi denetim edilmezse uzun vadede gerçek bir tehdit oluşturabilir.” dedi.

Üsküdar Üniversitesi Mühendislik ve Tabiat Bilimleri Fakültesi (MDBF) Bilgisayar Mühendisliği Kısmı Lideri Prof. Dr. Burhan Pektaş, yapay zekanın insanlığı yok etme olasılığı konusunu kıymetlendirdi.

Yapay Genel Zeka ve riskleri neler?

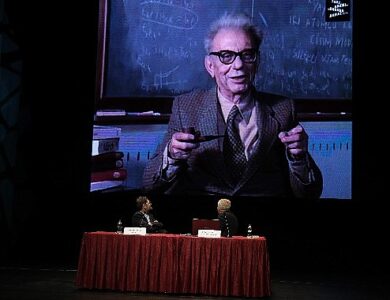

Yapay zekanın babası olarak tanınan Geoffrey Hinton’un, yapay zeka teknolojisinin gelecek 30 yılda insanlığı yok etme mümkünlüğünün arttığına ait kelamlarını pahalandıran Prof. Dr. Burhan Pektaş, “Geoffrey Hinton’un uyarısı, yapay zekanın (YZ) gelişimi sırasında denetim sistemlerinin yetersiz kalabileceği kaygısını yansıtıyor. Bu görüş, bilhassa ‘yapay genel zeka’ (AGI) olarak isimlendirilen, beşere misal öğrenme ve karar verme kapasitesine sahip sistemlerin ortaya çıkma ihtimaliyle ilgilidir. Riskler şunlar; Otonom denetim: YZ’nin kendi amaçlarını belirleyip bu maksatlara ulaşmak için insan çıkarlarını göz arkası etmesi. Silahlanma riski: Otonom silahların geliştirilmesi ve YZ’nin yanlış ellerde tehlikeli bir halde kullanılması. Bilgi manipülasyonu: Düzmece bilgi üretimi, seçimler ve toplumsal karar alma süreçlerini manipüle edebilir. Ekonomik denetim: Büyük şirketlerin YZ’yi tekelleştirmesi ve gelir eşitsizliğini artırması.” biçiminde konuştu.

Fiziksel, ekonomik, toplumsal ve kültürel tehditler

YZ’nin tehditlerinin yalnızca fizikî yıkımla hudutlu olmadığını, tıpkı vakitte toplumsal, ekonomik ve kültürel dönüşümleri de içerdiğini lisana getiren Prof. Dr. Burhan Pektaş, şu tehditleri şöyle sıraladı:

“Fiziksel tehditler: Otonom silah sistemleri, güvenlik açıklarına sahip YZ uygulamaları.

Ekonomik tehditler: YZ’nin iş gücünü ikame etmesi sonucu geniş çaplı işsizlik.

Sosyal tehditler: Dijital eşitsizlik, mahremiyetin yok edilmesi ve nezaret toplumlarının oluşumu.

Kültürel tehditler: İnsan bedellerinin ve özgün yaratıcılığın YZ sistemleriyle rekabetinde erozyon.”

Etik ve güvenlik standartları kâfi mi?

Yapay zeka teknolojilerinde etik kurallar ve güvenlik standartlarının geliştirilmesi konusuna ait de Prof. Dr. Burhan Pektaş, şu bilgileri verdi:

“Günümüzde bu alanda birtakım ilerlemeler kaydedilse de (örneğin Avrupa Birliği’nin AI Act’i gibi), global seviyede standartların geliştirilmesi hala yavaş ilerliyor. Bunun en önemli nedenleri: Uluslararası iş birliği eksikliği: Farklı ülkeler ortasında çıkar çatışmaları. Teknolojik sürat: YZ’nin gelişme suratı, düzenlemelerin uygulanma suratını aşıyor. Şirketlerin tesiri: Büyük teknoloji şirketlerinin lobicilik faaliyetleri.”

Büyük teknoloji şirketlerinin lobicilik faaliyetlerinin süreci yavaşlattığını lisana getiren Prof. Dr. Burhan Pektaş, “Küresel bağlayıcılığı olan kurallar oluşturulmalı. Bağımsız denetleme kurumları kurulmalı. Eğitim programlarıyla etik farkındalık artırılmalı.” dedi.

Çözüm teklifleri neler?

Yapay zekanın denetim dışına çıkmasını önlemek için atılması gereken adımlara da işaret eden Prof. Dr. Burhan Pektaş, denetim dışına çıkmayı önlemek için tekliflerini şöyle sıraladı:

“Şeffaflık: Tüm YZ modellerinin nasıl çalıştığı kamuoyuna açık olmalı.

Güvenlik testleri: YZ sistemlerinin insan ziyanına yol açmayacağını garanti eden bağımsız testler yapılmalı.

Uluslararası iş birliği: Tüm ülkeler ortasında bağlayıcı mutabakatlar sağlanmalı.

Etik kontrol: YZ geliştiren şirketler nizamlı etik kontrollerden geçirilmeli.

Kill switch düzenekleri: YZ’nin istenmeyen bir duruma yol açması halinde durdurulmasını sağlayan teknik tahliller uygulanmalı.”

Distopik senaryolar gerçek olabilir mi?

Prof. Dr. Burhan Pektaş, yapay zekanın beşerler üzerinde denetim sağlaması yahut ziyan verme ihtimalinin büsbütün dışlanamayacağını söz ederek, “Bu çeşit distopik senaryoların büsbütün imkansız olduğunu söylemek sıkıntı. Fakat, mevcut YZ sistemleri, evvelce belirlenmiş gayelere bağlı olarak çalışır ve kendi başına maksat oluşturamaz. Buna karşın; Riskli senaryolar: Otonom sistemlerin yanlış algoritmalarla çalışması yahut berbat niyetli bireyler tarafından berbata kullanılması tehlike oluşturabilir. Gerçeklik hissesi: Günümüzde bu risklerin büyük kısmı varsayımsal olsa da YZ’nin süratli gelişimi denetim edilmezse uzun vadede gerçek bir tehdit oluşturabilir.” biçiminde kelamlarını tamamladı.

Kaynak: (BYZHA) Beyaz Haber Ajansı